引言

2024年,全球人工智能領域正經歷一場由大模型驅動的深刻變革。以GPT、Claude、Gemini、Llama等為代表的預訓練大模型,正從實驗室走向千行百業,重塑著人工智能應用軟件(AI-Enabled Software)的開發范式、技術架構與商業模式。本報告旨在系統梳理當前大模型全棧技術生態,深入分析其對AI應用軟件開發帶來的機遇與挑戰,并展望未來發展趨勢。

一、 大模型技術棧全景:從基礎設施到上層應用

AI大模型的全棧技術可劃分為四個關鍵層級:

- 算力基礎設施層:以英偉達(GPU)、AMD、谷歌(TPU)及眾多云服務商(AWS、Azure、GCP、阿里云、騰訊云等)為核心,提供模型訓練與推理所必需的強大算力。2024年的焦點是推理優化,通過專用芯片(如NPU)、模型壓縮、量化技術大幅降低部署成本。邊緣計算與大模型的結合也成為新熱點。

- 模型與平臺層:

- 基礎大模型:閉源與開源路線并行。閉源模型(如GPT-4、Claude 3)追求性能極限;開源模型(如Llama 3、Qwen、DeepSeek)在透明性、可控性和定制化方面優勢顯著,成為企業私有化部署的主流選擇。

- 模型平臺/市場:Hugging Face、Replicate、ModelScope等平臺匯聚了海量模型,提供一站式的模型發現、微調、評估與部署服務,極大降低了模型獲取與使用的門檻。

- MaaS(模型即服務):云廠商將大模型能力封裝為API服務,是快速構建AI應用的最便捷路徑。

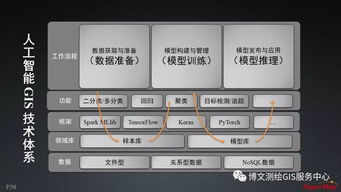

- 開發與工具層:這是連接大模型能力與具體應用場景的核心環節。

- 提示工程與上下文優化:System Prompt設計、思維鏈(CoT)、Few-shot Learning等技術是高效激發模型能力的基礎。

- 檢索增強生成(RAG):通過將外部知識庫(如企業文檔、數據庫)與大模型結合,有效解決模型幻覺、知識過時和專有知識不足的問題,已成為構建企業級AI應用的“標配”架構。

- 智能體(Agent)框架:LangChain、LlamaIndex、AutoGen等框架通過賦予大模型使用工具(搜索、計算、API調用)、規劃任務、執行多步推理的能力,使AI應用從“聊天機器人”升級為能夠自主完成復雜任務的“智能工作流”。

- 微調與持續訓練:LoRA、QLoRA等參數高效微調技術,使得企業能以較低成本,利用自有數據對基礎模型進行領域適配和性能優化。

- 應用層:基于上述技術棧,AI應用軟件正在各個領域落地開花:

- 生產力工具:Copilot形態已滲透至代碼開發(GitHub Copilot)、辦公軟件(Microsoft 365 Copilot)、設計(Adobe Firefly)等。

- 垂直行業解決方案:金融風控、醫療輔助診斷、法律文書分析、教育個性化輔導等場景的專用AI應用。

- 新一代交互界面:自然語言成為新的操作系統和交互范式,催生了AI助手、對話式分析平臺等。

二、 人工智能應用軟件開發范式的根本性轉變

大模型技術棧的成熟,使得AI應用軟件開發呈現出與傳統軟件及早期AI應用截然不同的新范式:

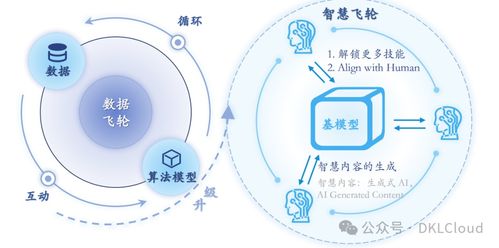

- 從“模型中心”到“應用中心”:開發者無需從零開始訓練復雜的專用模型,而是基于強大的基礎模型,聚焦于提示工程、知識庫構建、工作流編排和用戶體驗設計。開發的核心從“煉丹”轉向“組裝”和“引導”。

- 從“確定性的程序邏輯”到“概率性的交互協作”:傳統軟件遵循嚴格的if-else邏輯。大模型應用則需處理非確定性的輸出,開發重點轉向設計評估、校驗、糾錯和人工反饋(RLHF) 的機制,確保系統的可靠性與安全性。

- 從“功能實現”到“價值對齊與合規”:隨著應用深入核心業務,可解釋性、公平性、數據隱私(GDPR等)、版權合規(訓練數據來源) 成為產品設計與開發中必須前置考量的關鍵要素。AI治理與安全框架的構建變得至關重要。

- 開發門檻的雙重性:一方面,借助高階API和框架,原型驗證和簡單應用開發的門檻大幅降低;另一方面,要構建穩定、高效、可擴展的企業級生產系統,需要對大模型原理、分布式系統、成本優化有深刻理解的全棧AI工程師,人才門檻反而提高。

三、 關鍵挑戰與應對策略

- 成本與性能的平衡:大模型推理成本高昂,響應延遲可能影響體驗。策略包括:

- 模型選型:根據場景選擇“大小模型混合”策略,簡單任務用小模型或專用模型,復雜任務用大模型。

- 緩存與優化:對常見查詢結果進行緩存,使用量化、剪枝等技術壓縮模型。

- 異步與流式處理:對非實時任務采用異步處理,對長文本生成采用流式輸出。

- 可靠性(幻覺與事實性):

- RAG架構的深度應用:確保回答嚴格基于提供的權威知識源。

- 多步驗證與溯源:要求模型提供引用來源,或設計交叉驗證流程。

- 領域微調:在高質量領域數據上微調,提升模型的領域認知準確性。

- 數據安全與隱私:

- 私有化部署:采用開源模型在自有基礎設施上部署。

- 數據脫敏與加密:在調用外部API前對敏感信息進行處理。

- 合規的數據處理協議:明確訓練、微調數據的所有權和使用邊界。

- 技術迭代速度與工程化:技術棧日新月異,要求團隊保持快速學習能力,并建立穩健的MLOps for LLM(大模型運維)體系,涵蓋模型的版本管理、監控、A/B測試和持續迭代。

四、 2024年趨勢展望

- 小型化與專業化:追求極致的性能/成本比,催生更多針對特定場景優化的小型專家模型(Small Language Models, SLMs)。

- 多模態成為標配:圖文、音視頻理解與生成能力深度集成,使AI應用能處理更豐富的現實世界信息。

- 智能體(Agent)生態爆發:具備自主規劃與執行能力的智能體將從演示走向實用,在客服、游戲、科研、自動化流程中扮演核心角色。

- AI原生應用重構工作流:不再是“為舊流程添加AI功能”,而是誕生完全基于自然語言交互、由AI協同人類重新設計的“AI原生”應用,徹底改變軟件形態。

- 標準化與開源治理:模型接口、評估基準、安全規范將逐步形成行業標準;開源社區在推動技術民主化和建立可信AI方面作用愈發關鍵。

結論

2024年,全球AI大模型技術棧已進入深化應用與產業融合的關鍵期。人工智能應用軟件開發的核心競爭,正從單純的模型能力比拼,轉向對行業知識的深度理解、對技術棧的嫻熟集成、對復雜系統工程的把控能力,以及對負責任AI的堅定實踐。成功者將是那些能最快將大模型的“通用智能”潛力,轉化為解決具體業務痛點、創造真實用戶價值的“專用智能”解決方案的團隊與企業。全棧技術是基石,而真正的黃金位于垂直應用的深處。